Sul podio dei supercomputer ci sono ormai da tempo un cinese e due americani. Il gradino più alto è occupato dal Tianhe-2, dal nome altamente simbolico che significa Via Lattea, un sistema con oltre tre milioni di core e sistema operativo Kylin Linux, sviluppato dal National Supercomputer Center di Guangzhou in Cina: ha una potenza di calcolo di quasi 34 milioni di miliardi di operazioni al secondo (PetaFlop/s). Gli inseguitori arrivano alla metà di tale potenza, si basano su architetture parallele e sono in dotazione al Dipartimento americano per l’Energia: il Titan utilizza tecnologia AMD e si trova presso l’Oak Ridge National Laboratory (Tennessee); il Sequoia applica tecnologia PowerPC ed è installato al Lawrence Livermore National Laboratory (California).

Il fatto è che macchine del genere sono enormemente dispendiose dal punto di vita energetico: il loro costo medio annuo per il consumo di energia è stimato in alcuni milioni di euro. D’altra parte il loro impiego è sempre più necessario; anzi, dai PetaFlop si tende a passare agli ExaFlop, a lavorare cioè alla exascala, dove le operazioni eseguite ogni secondo possono arrivare al miliardo di miliardi. Sono quelle necessarie per risolvere le equazioni differenziali alle derivate parziali che descrivono molti aspetti della nostra vita e molti grandi interrogativi scientifici legati appunto alla risoluzione di complessi sistemi di equazioni relativi alle leggi di conservazione della fisica: dalle soluzioni di queste equazioni si possono ricavare accurati modelli di previsione sulle dinamiche dell’universo, sugli eventi naturali e persino sul nostro stato di salute, analizzando ad esempio le caratteristiche del flusso sanguigno.

Ecco allora spiegato l’impegno assunto dalla Commissione Europea che ha da poco finanziato il progetto ExaHyPE (An Exascale Hyperbolic PDE Engine), con l’obiettivo di rendere questi supercomputer più potenti, flessibili e soprattutto più economici sviluppando un nuovo software di simulazione delle leggi di conservazione della fisica capace di sfruttare tutta la potenza dei supercomputer di nuova generazione. Al progetto, di durata quadriennale, lavora un team internazionale di scienziati provenienti da Germania, Regno Unito, Russia e Italia, che prende parte alle ricerche con il Laboratorio di matematica applicata dell’Università di Trento, coordinato dal professor Michael Dumbser.

Sono quattro i principali obiettivi di ExaHyPE. Il primo è relativo all’efficienza energetica dell’hardware per il supercomputing: attualmente un supercomputer in grado di eseguire calcoli al ritmo di 1 exaFlop al secondo potrebbe anche essere costruito, ma il suo fabbisogno energetico sarebbe proibitivo. Col nuovo software di simulazione che si sta progettando si pensa di poter far fronte alle esigenze del futuro hardware contenendo i consumi energetici.

Un secondo obiettivo riguarda lo sviluppo di nuovi algoritmi matematici che possono trarre il massimo vantaggio della più piccola quantità possibile di memoria. Saranno algoritmi scalabili e dinamicamente adattivi: la risoluzione di una simulazione – cioè il numero di punti di dati utilizzati – sarà aumentata dinamicamente in base alle esigenze; in tal modo, le operazioni necessarie possono essere ridotti al minimo e contemporaneamente si può ottenere la massima precisione possibile.

Un altro obiettivo è volto a combinare velocità e capacità di memoria. Tra dieci anni i supercomputer potranno operare mille volte più velocemente di oggi; tuttavia, nello stesso periodo, la capacità di memoria può aumentare solo 50 volte. Per far fronte a questa discrepanza è necessario allora riscrivere completamente i programmi di simulazione: gli algoritmi che verranno utilizzati in ExaHyPE saranno intrinsecamente efficiente quanto a memoria e saranno in grado di ridurre la comunicazione durante l’elaborazione parallela.

Infine la garanzia di parallelismo estremo anche con hardware inaffidabili. Entro il 2020 i supercomputer avranno centinaia di milioni di processori “core” e per massimizzare l’efficienza dovranno sviluppare nuovi programmi che possano girare su simili computer. ExaHyPE esaminerà la distribuzione dinamica delle operazioni di computer a milioni di processori anche nel caso che alcuni di essi si guastino durante l’esecuzione di calcoli.

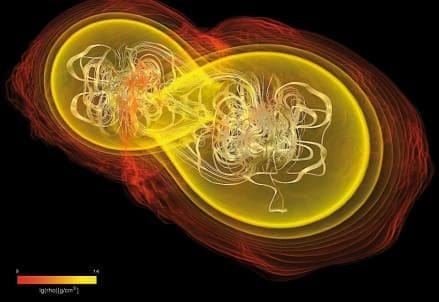

Alcune possibili applicazioni alle quali lavorerà il progetto ExaHype sono state indicate da Dumbser e riguardano i due diversi scenari della geofisica e del’astrofisica: «Nel primo caso potremo sviluppare il calcolo del rischio associato ai terremoti. I terremoti non possono essere previsti; tuttavia le simulazioni di un exascale supercomputer potrebbero aiutare a valutare i rischi di scosse di assestamento. Le simulazioni su base regionale sembra consentano una migliore comprensione di cosa avvenga durante i terremoti su larga scala e nella fase successiva di assestamento. Nel campo dell’astrofisica i nuovi strumenti matematici sviluppati in ExaHype potrebbero simulare la fusione di stelle di neutroni orbitanti. Potremo quindi simulare le onde gravitazionali e le esplosioni di raggi gamma: si ritiene infatti che quei fenomeni non soltanto siano alla base della formazione delle onde gravitazionali, ma che possano costituire anche la causa delle esplosioni di raggi gamma».

Resta da sottolineare che tutto il nuovo software sarà mantenuto “open source” dai ricercatori, così da poter essere utilizzato in diversi ambiti di ricerca per effettuare varie previsioni e modelli statistici.